Choix matériel éclairé

- Contraintes produit : latence, consommation, confidentialité et coût dictent le choix matériel; tester en conditions réelles s’impose.

- NPU versus MCU : le NPU maximise la vision à haute perf mais impose intégration; le MCU privilégie faible consommation.

- Plan d’action : benchs réels, définition stricte du MVP, bancs hardware et tests automatisés valident l’option et réduisent risques d’intégration en production finale.

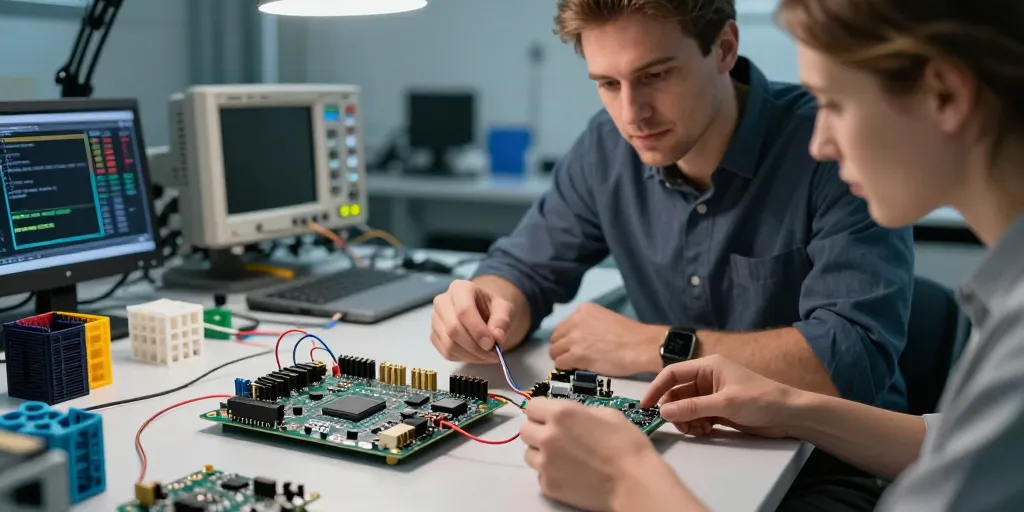

Une caméra tremble sur une chaîne industrielle. La latence transforme ce bourdonnement en incident. Le choix du composant détermine la réactivité du prototype. Ce dilemme oppose NPU et MCU sur la balance énergie coût et délai. Votre équipe doit évaluer contraintes produit avant toute sélection matérielle. On lit souvent fiches techniques sans tester les cas réels. Le NPU accélère la vision.

Le contexte et les enjeux pour un prototype industriel confronté au choix NPU ou MCU

Une sélection matérielle démarre par une vérification des contraintes produit. La décision nécessite priorisation entre latence consommation confidentialité et coût.

Le besoin de latence confidentialité et bande passante pour décider d’un dispositif

Une évaluation doit chiffrer latence et trafic réseau. Le choix s’appuie sur exigences temps réel confidentialité et coûts de connectivité. Ce TinyML réduit l’empreinte mémoire. Vous vérifiez gains en latence et trafic avant validation.

La contrainte énergétique et thermique dans les environnements industriels à considérer

La mesure du budget énergétique guide l’architecture. Le MCU excelle sur budgets µW à mLes MCUs consomment très peu. On vérifie dissipation thermique en conditions industrielles.

Ce point relie enjeux à métriques techniques. Le comparatif suivant précise ops par seconde consommation et latence.

Le comparatif technique et énergétique entre NPU et MCU pour l’inférence en périphérie

Une comparaison se base sur mesures reproductibles plutôt que datasheets. Le benchmarking priorise ops par seconde consommation et latence pour trancher.

| Critère | NPU | MCU |

|---|---|---|

| Type de charge | Inferencing parallèle pour CNNs et vision | Inferencing léger et contrôle temps réel |

| Performance | Ops élevés faible latence | Ops modestes selon fréquence |

| Consommation | Meilleur perf/W mais plus de puissance en pointe | Très faible consommation au repos et en fonctionnement |

| Complexité d’intégration | Plus d’efforts logiciels et drivers | Écosystème mature et simple à intégrer |

Le rendement d’inférence et métriques clés pour comparer NPU versus MCU en production

Le choix passe par ops par seconde temps d’inférence consommation et précision équilibrée. Vous mesurez end to end latency et énergie par inférence sur charges réelles. Le quantifier en 8 bits aide. On privilégie benchs réels plutôt que datasheets génériques.

La consommation et mode de calcul à comparer avec chiffres et ordres de grandeur pratiques

Une fourchette pratique se situe en mW et en joules par inférence selon modèle. Le NPU offre meilleur perf par watt mais pointe en puissance. Le NPU chauffe sous charge soutenue. Vous réalisez benchs sur workload ciblé pour décider.

Ce comparatif identifie applications profitant du NPU ou MCLa cartographie suivante aide à décider selon usage.

Le choix pratique selon cas d’usage industriel et contraintes produit

Le profil d’usage détermine architecture et risques. Une association claire limite coûts et efforts.

Le profil d’application idéal pour un NPU dans les prototypes industriels courants

Le NPU brille pour vision temps réel et multimédia. Les NPUs facilitent quantification 8 bits pour modèles lourds. On valide performances sur matériel réel avant industrialisation. Vous prévoyez refroidissement et marge thermique si nécessaire.

La pertinence d’un MCU quand la simplicité et le coût restent prioritaires dans un POC

Une solution MCU suffit pour capteurs simples et détection d’anomalies. Le TinyML permet cycles de développement courts et efficients. Les MCUs réduisent coût et complexité. Vous gagnez temps de mise en chantier et consommation de veille.

Ce choix se concrétise avec frameworks et SDKs. La section suivante présente outils selon cible matérielle.

Le catalogue outils et frameworks recommandés pour déployer un modèle sur NPU ou MCU

Le mapping outil vers matériel réduit surprises d’intégration. Une sélection dépend mémoire temps réel et contraintes de latence.

| Outil ou framework | Cible recommandée | Usage typique |

|---|---|---|

| TensorFlow Lite Micro | MCU | TinyML détection simple classification |

| SDK fabricant NPU | NPU | Optimisation kernels quantifiés vision et audio |

| ONNX runtime edge | SoC avec NPU | Interopérabilité modèles et conversion |

Le choix de frameworks TinyML TensorFlow Lite Micro et outils d’optimisation pour MCU

Le TensorFlow Lite Micro cible MCU et TinyMVous documentez pipeline quantification pruning et tests unitaires pour MCOn profile mémoire et cycles pour respecter limites MCVous intégrez tests automatiques pour chaque build.

La sélection de modules NPU jak accélérateurs et bibliothèques pour vision et audio embarqué

La compatibilité SDK et format modèle se vérifie en amont. Le vendor SDK offre optimisations natives et kernels spécifiques. Les tests hardware évitent surprises d’intégration. Vous testez modèles quantifiés sur accélérateurs réels.

Ce catalogue mène au plan d’action suivant. La roadmap précise jalons ressources et métriques pour POC.

Le plan d’action et les compétences nécessaires pour mener un prototype jusqu’au proof of concept

Le plan s’organise en itérations rapides de bench et test. Une définition claire de MVP et métriques évite dérives.

Le MVP doit contenir ces éléments avant validation.

- Le dataset représentatif annoté et nettoyé

- La métrique d’acceptation et seuils précis

- Un pipeline de test automatisé

- Des bancs hardware pour validation

- La revue risques et conformité

Le calendrier et budget recommandés pour valider un prototype IA embarquée en interne

Le calendrier propose 3 à 6 mois selon complexité. Vous allouez budget pour hardware prototypes licences et tests industriels. Le bench en conditions réelles rassure. On planifie itérations et revues régulières.

Les compétences et formation à mobiliser pour concevoir intégrer et maintenir la solution

Une équipe rassemble firmware ML ops ingénierie système et sécurité. Vous formez à TinyML quantification debugging embarqué et optimisation mémoire. On prévoit documentation et procédures de maintien. Vous anticipez montée en charge des équipes opérationnelles.

Ce plan donne envie d’expérimenter rapidement. Une démarche itérative réduit risques d’intégration et dépenses. Vous téléchargez benchs testez fournisseurs et planifiez démos pour valider choix.